Vos rapports Power BI se rafraîchissent encore manuellement chaque matin ? Vos analystes passent des heures à recharger des datasets plutôt qu’à interpréter les données ? Ce scénario est plus courant qu’on ne le croit dans les équipes BI, et il coûte cher en temps, en erreurs et en opportunités manquées. Optimiser ses workflows BI n’est pas un luxe réservé aux grandes DSI : c’est une nécessité opérationnelle pour toute organisation qui veut piloter sa performance en temps réel. Cet article vous propose un parcours structuré, de la préparation technique à la formation des équipes, pour transformer vos processus BI en moteurs d’efficacité.

Table des matières

- Préparer l’optimisation de vos workflows BI

- Étapes clés pour optimiser vos workflows BI

- Automatiser et sécuriser l’actualisation des données

- Former vos équipes pour pérenniser l’optimisation

- Notre retour d’expérience sur l’optimisation des workflows BI

- Solutions d’accompagnement Power BI pour vos workflows

- Questions fréquentes

Points Clés

| Point | Détails |

|---|---|

| Préparer outils et ressources | Identifiez les sources de données, configurez les passerelles et planifiez l’actualisation pour optimiser votre workflow BI. |

| Automatiser les actualisations | Utilisez la fonction incremental refresh et la planification automatique pour obtenir des données fiables sans effort. |

| Sécuriser vos processus | Paramétrez les niveaux de confidentialité et privilégiez une architecture sécurisée afin de garantir la protection des données. |

| Former les équipes | Assurez-vous que vos collaborateurs sont formés aux outils Power BI et aux processus automatisés pour pérenniser l’optimisation. |

| Éviter les pièges courants | Ne surestimez pas DirectQuery, adaptez chaque optimisation à la taille de vos datasets et à vos besoins réels. |

Préparer l’optimisation de vos workflows BI

Après avoir établi la pertinence d’optimiser vos workflows BI, précisons les ressources qu’il faudra mobiliser pour réussir.

Avant de toucher à la moindre configuration dans Power BI, il est indispensable de réaliser un état des lieux précis. Trop d’équipes sautent cette étape et se retrouvent à optimiser des processus mal compris, ce qui génère de nouveaux problèmes plutôt que de les résoudre. La préparation est la fondation de toute démarche d’amélioration durable.

Identifier les sources de données et leur accessibilité

La première question à se poser est simple : d’où viennent vos données ? Bases SQL on-premises, fichiers Excel partagés sur SharePoint, API cloud, ERP métier… chaque source a ses contraintes d’accès, de latence et de format. Cartographier ces sources permet d’anticiper les points de friction avant qu’ils ne bloquent une actualisation automatique à trois heures du matin.

Il faut également évaluer la fréquence de mise à jour souhaitée pour chaque dataset. Un tableau de bord de suivi des ventes nécessite peut-être une actualisation horaire, tandis qu’un rapport RH mensuel peut se contenter d’une mise à jour hebdomadaire. Cette distinction conditionne directement le choix de votre licence Power BI et votre architecture technique.

Configurer les passerelles et les niveaux de confidentialité

Pour les sources on-premises, la passerelle de données est incontournable. Il faut configurer la passerelle pour les sources on-premises et définir les niveaux de confidentialité afin d’éviter les fuites de données entre sources de nature différente. Une passerelle mal configurée est l’une des causes les plus fréquentes d’échec silencieux des actualisations planifiées.

Les niveaux de confidentialité (Public, Organisationnel, Privé) dans Power Query ne sont pas qu’une formalité administrative. Ils déterminent si Power BI peut combiner des données de sources différentes lors des requêtes. Une mauvaise configuration peut bloquer des transformations entières ou, pire, exposer des données sensibles.

Voici les ressources et outils à préparer avant de lancer votre optimisation :

- Power BI Desktop (version à jour) pour modéliser et tester les transformations

- Power BI Gateway pour les connexions aux sources on-premises

- Accès administrateur au service Power BI pour configurer les actualisations

- Documentation des sources de données avec types, volumes et fréquences de mise à jour

- Inventaire des rapports existants avec leurs dépendances et leurs audiences

- Compte de service dédié pour les actualisations automatiques, distinct des comptes nominatifs

Pour aller plus loin dans la structuration de votre approche, les ressources sur l’automatisation du pilotage Power BI offrent des perspectives concrètes sur les cas d’usage métier. De même, explorer les méthodes de travail BI permet de comprendre comment aligner les pratiques techniques avec les besoins organisationnels.

| Ressource | Rôle | Priorité |

|---|---|---|

| Power BI Gateway | Connexion sources on-premises | Critique |

| Compte de service | Actualisations automatiques | Critique |

| Power BI Premium | Fréquence élevée et grands volumes | Recommandée |

| Documentation sources | Cartographie et gouvernance | Importante |

Conseil de pro : Créez un document de gouvernance BI qui liste chaque dataset, sa source, son responsable métier et sa fréquence d’actualisation cible. Ce document devient la référence unique pour toute l’équipe et évite les malentendus lors des incidents.

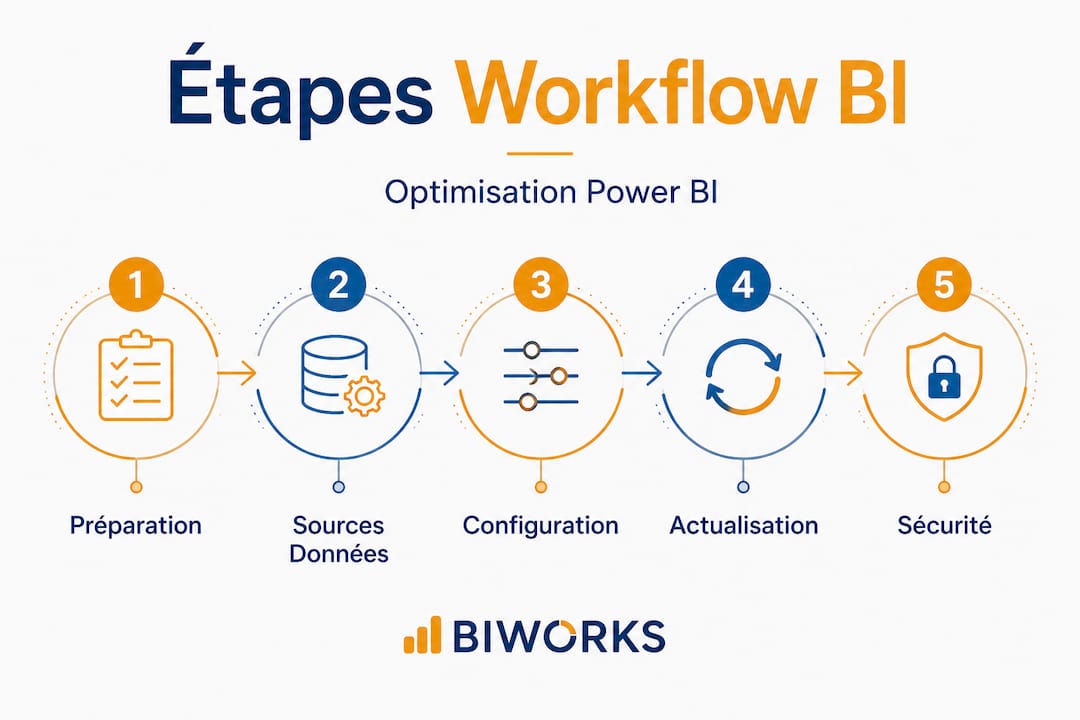

Étapes clés pour optimiser vos workflows BI

Avec une base solide, passons aux actions concrètes qui transforment le workflow.

L’optimisation d’un workflow BI se joue sur plusieurs niveaux simultanément : la fréquence d’actualisation, le volume de données traité, et le mode de connexion choisi. Chaque décision technique a des répercussions directes sur les performances et sur l’expérience des utilisateurs finaux.

Planifier l’actualisation automatique selon vos besoins

La planification de l’actualisation est la première brique de l’automatisation. Avec Power BI Pro, vous pouvez programmer jusqu’à 8 actualisations par jour. Avec Power BI Premium, les données se rafraîchissent jusqu’à 48 fois par jour, ce qui ouvre la voie à des tableaux de bord quasi temps réel pour les directions opérationnelles.

Voici les étapes pour mettre en place une planification efficace :

- Accéder aux paramètres du dataset dans le service Power BI

- Activer la connexion à la passerelle pour les sources on-premises

- Définir les plages horaires en évitant les pics de charge serveur

- Configurer les notifications d’échec pour être alerté immédiatement en cas de problème

- Tester manuellement avant d’activer la planification automatique

- Documenter la configuration dans votre registre de gouvernance

Choisir entre Import, DirectQuery et actualisation incrémentielle

Le choix du mode de connexion est l’une des décisions les plus structurantes. Pour les grands volumes de données, il est recommandé d’utiliser l’actualisation incrémentielle et d’éviter DirectQuery sauf nécessité de données en temps réel, car ce mode introduit de la latence et des limitations techniques importantes.

Le mode Import charge les données dans le modèle Power BI et offre les meilleures performances de navigation. DirectQuery interroge la source à chaque interaction, ce qui garantit la fraîcheur des données mais peut ralentir considérablement l’expérience utilisateur. L’actualisation incrémentielle est le meilleur compromis pour les datasets volumineux : seules les données nouvelles ou modifiées sont rechargées, ce qui réduit drastiquement les temps d’actualisation.

| Mode | Performance | Fraîcheur des données | Idéal pour |

|---|---|---|---|

| Import | Excellente | Selon planification | Reporting standard, volumes < 1M lignes |

| DirectQuery | Variable | Temps réel | Données critiques temps réel uniquement |

| Actualisation incrémentielle | Très bonne | Selon planification | Grands volumes, historiques longs |

| Agrégations | Excellente | Selon planification | Datasets très larges avec drill-down |

Les composantes en amont et en aval de la chaîne BI influencent directement ces choix techniques. Par exemple, si votre entrepôt de données cloud est déjà optimisé avec des vues agrégées, le mode Import devient encore plus performant. Pour une vision complète de l’écosystème, la BI cloud Power BI et Fabric offre des architectures de référence adaptées aux besoins des entreprises modernes.

Conseil de pro : Avant de basculer un rapport existant en actualisation incrémentielle, vérifiez que votre source de données supporte le “query folding”, c’est-à-dire la capacité à repousser les filtres de dates directement vers la base de données. Sans cette fonctionnalité, l’actualisation incrémentielle n’apportera pas les gains espérés.

Automatiser et sécuriser l’actualisation des données

Après l’optimisation des processus, il faut garantir la régularité et la sécurité de l’actualisation des données.

L’automatisation sans sécurité est une promesse à moitié tenue. Un workflow qui tourne seul mais expose des données sensibles crée un risque bien plus grave que l’inefficacité initiale. Ces deux dimensions doivent être traitées conjointement.

Programmer l’actualisation selon votre licence

La fréquence d’actualisation disponible dépend directement de votre offre. La planification automatique est possible jusqu’à 8 fois par jour en licence Pro et jusqu’à 48 fois par jour en Premium. Cette différence est souvent décisive dans le choix de la licence pour les équipes BI exigeantes.

“Une actualisation automatique bien configurée transforme un tableau de bord statique en véritable outil de pilotage opérationnel. La donnée n’attend plus l’analyste : elle est prête quand le décideur en a besoin.”

Cette réalité change profondément la relation entre les équipes BI et les directions métier. Quand les données sont toujours à jour, la confiance dans les rapports augmente et les décisions s’appuient sur des faits récents plutôt que sur des intuitions.

Configurer la sécurité et les accès

La sécurisation des données dans Power BI repose sur plusieurs couches complémentaires :

- Row-Level Security (RLS) : restreindre l’accès aux lignes de données selon le profil de l’utilisateur, essentiel pour les rapports partagés entre régions ou entités

- Niveaux de confidentialité Power Query : éviter les croisements involontaires entre données publiques et données sensibles lors des transformations

- Gestion des identités : utiliser Azure Active Directory pour centraliser les droits d’accès et faciliter les audits

- Chiffrement des données : activer le chiffrement au repos et en transit pour toutes les sources connectées

- Journalisation des accès : activer les logs d’audit dans le portail d’administration Power BI pour tracer les consultations sensibles

Pour les organisations qui traitent des données comptables ou financières, les enjeux de conformité sont particulièrement élevés. Les bonnes pratiques pour sécuriser les données comptables dans un environnement Power BI et Azure détaillent les configurations recommandées pour rester conforme au RGPD et aux exigences sectorielles.

Statistique clé : Selon les analyses de terrain, les incidents de sécurité liés à Power BI proviennent dans la majorité des cas non pas d’une faille technique, mais d’une mauvaise configuration des droits d’accès ou de l’absence de RLS sur des rapports partagés à grande échelle.

Former vos équipes pour pérenniser l’optimisation

Pour garantir l’efficacité sur le long terme, il est primordial d’investir dans la montée en compétences.

Imaginez la scène : vous avez passé trois semaines à configurer une architecture BI optimale, avec des actualisations automatiques, des agrégations bien pensées et une sécurité solide. Puis votre analyste principal quitte l’entreprise. Sans documentation ni formation, tout ce travail devient une boîte noire que personne n’ose toucher. La formation n’est pas un coût, c’est une assurance.

Identifier les besoins et structurer la montée en compétences

La maîtrise des processus automatisés est essentielle pour que les optimisations soient pérennes et ne reposent pas uniquement sur une ou deux personnes clés. Cette dépendance à des experts isolés est l’un des risques les plus sous-estimés dans les projets BI.

Pour structurer la formation de votre équipe, voici les compétences à développer par profil :

- Analystes BI : maîtrise de Power Query, des mesures DAX, de la création de rapports interactifs et de la publication sur le service Power BI

- Administrateurs BI : configuration des passerelles, gestion des workspaces, sécurité RLS et surveillance des actualisations

- Responsables métier : lecture et interprétation des tableaux de bord, création de rapports simples en autonomie, culture du self-service BI

- Équipes IT : intégration avec Azure, gestion des licences, déploiement et mise à jour des passerelles

Favoriser la culture du self-service BI

Le self-service BI est l’objectif ultime de toute organisation mature sur le plan analytique. Quand les équipes métier peuvent créer leurs propres rapports sans dépendre systématiquement de la DSI, la vélocité décisionnelle augmente considérablement. Cela suppose des formations adaptées, des modèles de données bien documentés et des espaces de travail bien organisés.

Les bonnes pratiques de partage sont tout aussi importantes que les compétences techniques. Mettre en place des revues de rapports mensuelles, partager les astuces DAX dans un canal Teams dédié, documenter les modèles de données dans un catalogue : autant d’habitudes qui transforment une équipe BI en communauté apprenante.

Conseil de pro : Structurez votre plan de formation en trois niveaux : découverte (2 jours), praticien (3 jours certifiants PL-300) et expert (ateliers avancés sur Fabric et DAX). Cette progression évite de surcharger les débutants tout en gardant les experts engagés. Pour les entreprises, un guide complet sur la formation Power BI en entreprise détaille comment structurer ce parcours de manière efficace et éligible au CPF.

Notre retour d’expérience sur l’optimisation des workflows BI

Après avoir présenté les étapes techniques, prenons du recul pour réfléchir à l’applicabilité réelle dans un contexte d’entreprise.

Sur le terrain, nous observons régulièrement deux erreurs symétriques qui sabotent les projets d’optimisation BI. La première est de surestimer DirectQuery. Beaucoup d’équipes choisissent ce mode par réflexe, convaincues que “données en temps réel” est toujours supérieur. En réalité, la grande majorité des décisions métier n’ont pas besoin de données actualisées à la seconde. Le coût en performance et en complexité de maintenance de DirectQuery dépasse souvent largement ses bénéfices pour des cas d’usage standards.

La seconde erreur est de sous-estimer la formation. Les équipes investissent dans des licences Premium, des architectures Azure sophistiquées et des consultants externes, puis négligent la montée en compétences interne. Résultat : les optimisations sont fragiles, dépendantes d’une seule personne, et les utilisateurs finaux continuent d’exporter des données en Excel parce qu’ils ne savent pas utiliser les fonctionnalités avancées de Power BI.

L’actualisation incrémentielle, elle, change véritablement la donne pour les organisations qui gèrent des historiques longs. Un dataset de transactions sur cinq ans peut peser plusieurs dizaines de gigaoctets. Sans actualisation incrémentielle, chaque rafraîchissement recharge l’intégralité de ces données, ce qui prend du temps et consomme des ressources. Avec une politique incrémentielle bien configurée, seules les données des derniers jours sont rechargées, réduisant les temps d’actualisation de 80 à 95 % dans les cas les plus favorables.

Ce qui est souvent négligé, c’est que Power BI évolue très rapidement. Microsoft publie des mises à jour mensuelles qui introduisent régulièrement de nouvelles fonctionnalités d’optimisation. Les pratiques recommandées en 2023 ne sont pas forcément les meilleures en 2026. Il faut donc maintenir une veille active et faire évoluer les pratiques de l’équipe en conséquence. Les ressources sur l’optimisation des méthodes de travail BI permettent de rester à jour sur ces évolutions sans s’y perdre.

Notre conviction, forgée sur des dizaines de projets BI en entreprise : l’optimisation technique sans accompagnement humain ne dure pas. La combinaison d’une architecture solide et d’équipes formées est la seule recette qui fonctionne sur le long terme.

Solutions d’accompagnement Power BI pour vos workflows

Après ce retour d’expérience, découvrez comment BIWORKS peut vous accompagner dans vos projets BI.

Optimiser ses workflows BI est un projet qui gagne à être accompagné par des experts qui connaissent à la fois les subtilités techniques de Power BI et les réalités opérationnelles des équipes en entreprise. Chez BIWORKS, nous combinons conseil personnalisé, réalisation de dashboards sur mesure et formations certifiantes pour vous aider à construire une BI performante et autonome.

Nos consultants Power BI interviennent directement dans vos projets pour auditer vos workflows existants, recommander les architectures adaptées et implémenter les optimisations les plus impactantes. Nos formations Power BI Créateur, certifiées Qualiopi et éligibles au CPF, préparent vos équipes à la certification PL-300 en trois jours. Pour explorer l’ensemble de nos ressources et solutions, notre espace dédié aux ressources Power BI vous donne accès à des guides, tutoriels et études de cas concrets.

Questions fréquentes

Quels sont les avantages de l’actualisation automatique des données Power BI ?

Elle permet d’obtenir des données à jour sans intervention manuelle, avec une fréquence pouvant atteindre 48 actualisations par jour en licence Power BI Premium, libérant ainsi les analystes pour des tâches à plus forte valeur ajoutée.

Que faire pour optimiser de grands ensembles de données de plus d’un million de lignes ?

Privilégiez l’actualisation incrémentielle et les agrégations pour limiter la quantité de données rechargées à chaque actualisation et améliorer significativement les temps de réponse des rapports.

Comment garantir la sécurité lors de l’actualisation de données ?

Configurez les niveaux de confidentialité dans Power Query, activez le Row-Level Security et privilégiez une architecture cloud sécurisée avec passerelle de données dédiée pour les sources on-premises.

Pourquoi éviter DirectQuery quand ce n’est pas indispensable ?

DirectQuery offre des données en temps réel mais introduit de la latence et des limitations techniques importantes : il est préférable de le réserver aux cas où la fraîcheur absolue des données est une exigence métier non négociable.

Recommandation

- Optimisez la comptabilité grâce à Power BI : automatisation et pilotage

- Les étapes clés d’un projet BI performant avec Power BI

- Optimisation des méthodes de travail grâce à la BI | BIWORKS

- Démarrer avec Power BI : guide simple pour les professionnels

- How to improve business workflows with AI automation