Automatiser sa Business Intelligence est devenu un impératif pour les organisations qui veulent prendre des décisions en quelques heures plutôt qu’en quelques semaines. Pourtant, beaucoup de responsables de transformation digitale se retrouvent face à la même réalité : des données éparpillées, des rapports construits à la main, et une équipe data qui passe plus de temps à copier-coller qu’à analyser. Ce guide automatisation business intelligence vous présente, étape par étape, comment Microsoft Power BI et Microsoft Fabric transforment ce processus en un pipeline fluide, fiable et évolutif, de l’ingestion des données jusqu’aux analyses prédictives intégrées.

Table des matières

- Préparer votre environnement pour automatiser la business intelligence

- Mettre en place le pipeline de données et le modèle sémantique

- Planifier et optimiser les rafraîchissements pour une automatisation efficace

- Gérer les déploiements et la gouvernance pour fiabiliser l’automatisation

- Enrichir la business intelligence avec le machine learning intégré à Fabric

- Perspective sur l’automatisation de la business intelligence avec Power BI et Fabric

- Accélérez votre transformation digitale avec les experts Power BI et Fabric

- Questions fréquentes sur l’automatisation de la business intelligence

Points Clés

| Point | Détails |

|---|---|

| Préparation essentielle | Bien préparer l’environnement avec Microsoft Fabric garantit une automatisation BI efficace et intégrée. |

| Pipeline automatisé | Construire des pipelines robustes et un modèle sémantique facilite la création de rapports dynamiques. |

| Rafraîchissement optimisé | Le rafraîchissement incrémental et la planification avancée améliorent la performance et la réactivité. |

| Gouvernance renforcée | Les deployment pipelines assurent sécurité, fiabilité et facilité de gestion des déploiements. |

| ML intégré | L’intégration du machine learning dans Fabric enrichit la BI avec des analyses prédictives avancées. |

Préparer votre environnement pour automatiser la business intelligence

Avant de lancer la moindre automatisation, il faut poser des fondations solides. Une erreur courante consiste à démarrer directement avec des outils sans avoir défini l’architecture qui va les porter. Résultat : des silos de données qui persistent, des accès mal configurés, et des rapports qui ne reflètent pas la réalité métier.

La bonne nouvelle, c’est que Microsoft Fabric simplifie radicalement cette étape. Comme son architecture l’indique, Fabric unifie ETL, entreposage et BI sur une plateforme unique, éliminant la duplication de données grâce à OneLake et Direct Lake. Concrètement, cela signifie que vos données ne sont stockées qu’une seule fois, accessibles par tous vos outils sans copie intermédiaire. C’est un changement de paradigme important par rapport aux architectures traditionnelles.

Voici les prérequis organisationnels et techniques à mettre en place avant toute chose :

- Définir les espaces de travail Fabric par domaine métier (finance, RH, ventes) pour isoler les responsabilités et faciliter la gouvernance.

- Configurer un Lakehouse comme couche de stockage centralisée, en distinguant les zones brutes, transformées et certifiées (bronze, silver, gold).

- Préparer les Dataflows Gen2 pour la couche de transformation, en identifiant les sources de données prioritaires (ERP, CRM, fichiers Excel).

- Établir les règles d’accès en s’appuyant sur les groupes Azure Active Directory pour contrôler qui voit quoi dès le départ.

- Activer Direct Lake pour permettre aux rapports Power BI d’interroger les données du Lakehouse en temps réel, sans import préalable.

Pour aller plus loin sur cette architecture, vous pouvez consulter notre introduction à Microsoft Fabric qui détaille les concepts fondamentaux.

| Composant | Rôle principal | Bénéfice clé |

|---|---|---|

| OneLake | Stockage centralisé unique | Élimine la duplication de données |

| Lakehouse | Couche bronze/silver/gold | Organise les données par niveau de qualité |

| Dataflows Gen2 | Transformation ETL | Réutilisable et versionnable |

| Direct Lake | Connexion temps réel | Supprime les imports répétitifs |

Conseil de pro : Résistez à la tentation de tout migrer d’un coup. Commencez par un seul domaine métier, idéalement celui où la douleur liée aux rapports manuels est la plus forte. Un premier succès rapide mobilisera bien mieux vos équipes qu’un projet global qui prend six mois à produire ses premiers résultats.

Mettre en place le pipeline de données et le modèle sémantique

Avec votre environnement prêt, la prochaine étape est le déploiement concret des pipelines et modèles. C’est ici que l’automatisation prend vraiment vie.

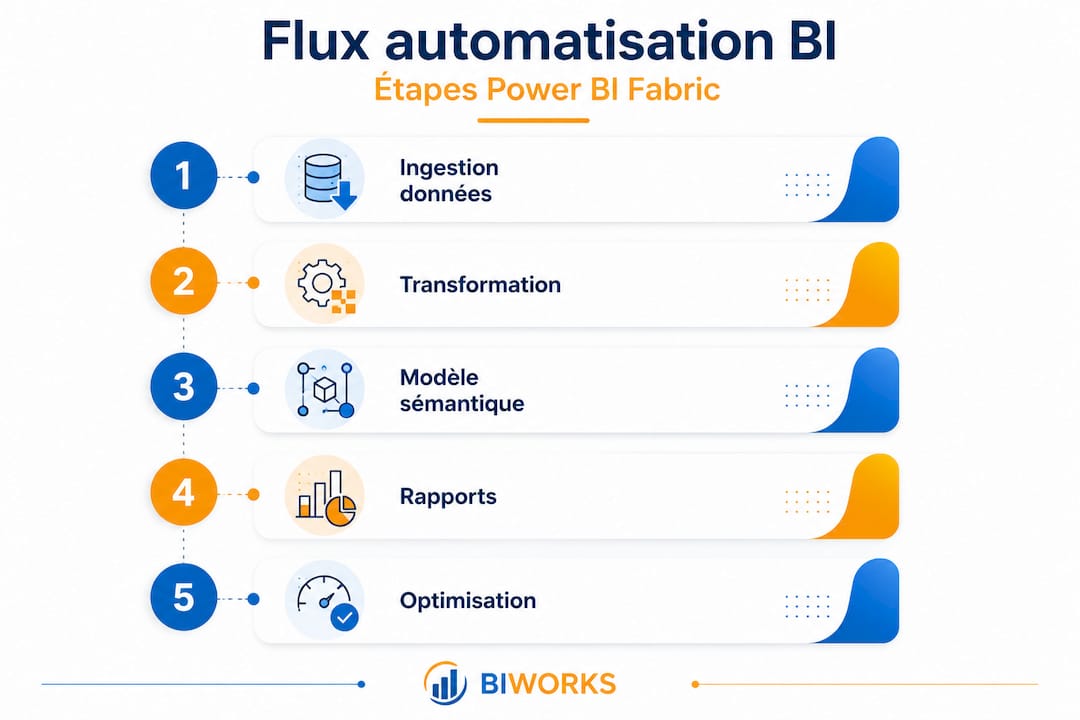

Les six étapes clés d’automatisation BI avec Power BI et Fabric couvrent l’ingestion via Data Pipelines, l’ETL avec Dataflows Gen2, la modélisation sémantique dans Lakehouse, les rafraîchissements planifiés, Direct Lake et la création rapide de rapports. Voici comment les enchaîner de façon logique :

- Configurer les Data Pipelines pour ingérer automatiquement vos sources : bases SQL, API REST, fichiers SharePoint ou flux Azure Event Hubs pour les données en quasi temps réel.

- Appliquer les transformations avec Dataflows Gen2, qui s’appuient sur Power Query pour nettoyer, fusionner et standardiser les données avant chargement dans le Lakehouse.

- Construire le modèle sémantique directement dans le Lakehouse en définissant les relations entre tables, les mesures DAX clés, et les hiérarchies de navigation utiles aux utilisateurs métier.

- Activer Direct Lake sur le modèle sémantique pour que chaque rapport Power BI accède aux données fraîches sans déclencher un import complet.

- Utiliser la fonctionnalité d’auto-création de rapports de Power BI, qui génère une première version de dashboard à partir du modèle sémantique, que vos analystes peuvent ensuite affiner.

- Documenter chaque étape du pipeline avec les annotations intégrées à Fabric, pour faciliter la maintenance et la montée en compétences de vos équipes.

Pour comprendre comment ces composants s’articulent visuellement, l’architecture Power BI et Fabric illustre bien les flux de données de bout en bout.

Conseil de pro : Construisez vos mesures DAX dans le modèle sémantique centralisé, jamais directement dans les rapports. Cela évite le cauchemar classique où chaque rapport calcule le chiffre d’affaires différemment, selon l’analyste qui l’a créé.

Planifier et optimiser les rafraîchissements pour une automatisation efficace

Une fois le pipeline déployé, il est essentiel d’automatiser sa mise à jour avec des planifications précises et efficaces. Un pipeline qui produit des données périmées n’est qu’une illusion d’automatisation.

Microsoft Fabric offre une flexibilité remarquable sur ce point. Les rafraîchissements planifiés dans Fabric supportent la planification mensuelle au Nième jour du mois, jusqu’à 10 actualisations par jour, avec un contrôle avancé sur les tables, partitions et le niveau de parallélisme. Cela permet d’adapter la cadence à chaque cas d’usage métier.

Pour réduire les temps de traitement, le rafraîchissement incrémental est votre meilleur allié. L’incremental refresh avec Dataflows Gen2 réduit le temps de rafraîchissement jusqu’à 80% en ne traitant que les nouvelles données plutôt que l’ensemble du jeu de données. Sur un historique de trois ans de transactions, l’impact est considérable.

Voici les bonnes pratiques à appliquer pour la planification :

- Définir des fenêtres de rafraîchissement en dehors des pics d’utilisation (nuit ou tôt le matin) pour ne pas dégrader l’expérience utilisateur.

- Activer le rafraîchissement incrémental dès que le volume de données dépasse 500 000 lignes, avec une fenêtre glissante de détection des modifications.

- Configurer des partitions distinctes par période (mois, trimestre) pour paralléliser le traitement et réduire la charge globale.

- Mettre en place des alertes de monitoring pour être notifié immédiatement en cas d’échec, avant que les utilisateurs ne le signalent.

Pour approfondir ces configurations, notre article sur la gestion des rafraîchissements avancés détaille les paramètres les plus efficaces.

| Scénario | Fréquence recommandée | Méthode |

|---|---|---|

| Reporting financier mensuel | 1 fois/mois, Nième jour | Data Pipeline Fabric |

| Tableau de bord opérationnel | 4 à 8 fois/jour | Planification Fabric + incrémental |

| Données temps réel critiques | Continu | Direct Lake sans import |

| Historique multi-années | 1 fois/nuit | Incrémental avec partitions |

Conseil de pro : Ne cédez pas à la tentation de rafraîchir toutes les heures par défaut. Chaque actualisation consomme des capacités Fabric. Analysez d’abord la fréquence réelle de mise à jour de vos sources pour calibrer intelligemment votre planification.

Gérer les déploiements et la gouvernance pour fiabiliser l’automatisation

Après avoir automatisé la mise à jour des données, il faut sécuriser et fiabiliser le processus avec une bonne gouvernance. Une automatisation sans contrôle devient vite un système que personne n’ose modifier, de peur de tout casser.

Les deployment pipelines réduisent de 70 à 80% la reconfiguration manuelle grâce à un déploiement structuré en trois étapes (dev/test/prod), avec conservation des rôles de sécurité Row-Level Security et intégration Git pour un processus CI/CD reproductible.

Voici comment structurer votre gouvernance de déploiement :

Les trois environnements à mettre en place :

- Développement : espace libre pour les équipes data, avec des données échantillonnées et sans impact sur la production.

- Test : validation fonctionnelle avec des utilisateurs métier clés, données réelles en volume limité.

- Production : environnement stable, accessible aux utilisateurs finaux, modifié uniquement via le pipeline de déploiement.

Les pratiques de gouvernance essentielles :

- Utiliser les deployment pipelines Power BI pour promouvoir les artefacts (rapports, modèles, dataflows) d’un environnement à l’autre de façon contrôlée.

- Préserver les règles RLS à chaque promotion, en vérifiant que les rôles de sécurité sont bien transposés sans reconfiguration manuelle.

- Connecter le workspace Fabric à un dépôt Git via Azure DevOps pour versionner toutes les modifications et permettre des retours arrière en cas d’erreur.

- Définir un processus d’approbation avant chaque mise en production, avec validation par un référent data et un référent métier.

- Auditer régulièrement les accès avec les journaux d’activité Power BI pour détecter les usages anormaux ou les droits devenus obsolètes.

Enrichir la business intelligence avec le machine learning intégré à Fabric

Enfin, l’automatisation peut être poussée plus loin en intégrant des analyses prédictives directement au sein de vos rapports BI. C’est là que la combinaison Power BI et Fabric devient un vrai différenciateur pour vos équipes.

Fabric permet de former, déployer et opérationnaliser des modèles ML dans les mêmes flux de données, sans duplication de logique, en intégrant les prédictions en batch et en temps réel directement dans Power BI. Imaginez un rapport de ventes qui affiche, à côté du chiffre d’affaires réel, la probabilité de churn de chaque client calculée automatiquement chaque matin. C’est précisément ce que permet cette intégration.

Les étapes pour intégrer le machine learning dans vos rapports BI :

- Définir le modèle sémantique unifié comme source de vérité pour vos modèles ML, afin que les mêmes définitions métier soient utilisées dans les rapports et dans les algorithmes.

- Créer et entraîner votre modèle dans Microsoft Fabric (via Notebooks Python et MLflow), par exemple un modèle de prédiction de churn ou de prévision des ventes.

- Déployer le modèle dans le registre Fabric et configurer le scoring batch via Dataflows Gen2 pour l’exécuter automatiquement à chaque rafraîchissement.

- Écrire les résultats de prédiction dans une table du Lakehouse, au même endroit que vos données transactionnelles.

- Visualiser les prédictions dans Power BI exactement comme n’importe quelle autre donnée, en créant des visuels de probabilité, de segmentation ou d’alerte.

Pour en savoir plus sur cette intégration, notre guide sur le machine learning avec Microsoft Fabric présente des exemples concrets par secteur d’activité.

- Cas d’usage finance : prédiction des impayés clients avec scoring de risque affiché directement dans le tableau de bord comptable.

- Cas d’usage RH : prévision du turnover par département intégrée au rapport mensuel des effectifs.

- Cas d’usage retail : optimisation des stocks par prévision de la demande, avec alertes automatiques dans Power BI.

Conseil de pro : Ne cherchez pas à construire un modèle ML parfait dès le départ. Commencez par un modèle simple (régression logistique pour le churn, par exemple) qui produit des prédictions utiles rapidement. Vous l’affinerez ensuite itérativement, une fois que les utilisateurs métier auront pris l’habitude de consulter ces prédictions.

Perspective sur l’automatisation de la business intelligence avec Power BI et Fabric

Après avoir accompagné de nombreuses organisations dans leur transformation data, nous constatons un pattern récurrent : les projets qui échouent ne tombent pas sur des problèmes techniques, ils tombent sur des problèmes de priorités mal posées.

La centralisation via Fabric réduit considérablement les incohérences entre rapports, mais elle exige une discipline organisationnelle que l’outil seul ne peut pas imposer. Qui valide qu’une mesure DAX est la bonne définition du taux de marge ? Cette question doit avoir une réponse humaine avant d’être codée dans un modèle.

Ce qui nous surprend encore, c’est la sous-estimation systématique du monitoring. Les équipes consacrent des semaines à construire des pipelines, puis rien pour surveiller leur bon fonctionnement. Un pipeline qui échoue silencieusement à 3h du matin, et dont personne ne se rend compte avant 11h lors d’une réunion de direction, c’est une perte de confiance difficile à reconstruire.

L’intégration du machine learning dans les flux BI est sans doute le différenciateur le plus sous-exploité aujourd’hui. Beaucoup d’organisations disposent déjà des données nécessaires. Ce qui leur manque, c’est la structure pour que les prédictions rejoignent naturellement les rapports opérationnels quotidiens, sans friction supplémentaire pour les utilisateurs.

Notre conviction, après plusieurs années de projets Fabric : la plateforme BI unifiée n’est pas une destination, c’est un point de départ. L’automatisation réussie est celle qui s’adapte à l’évolution de vos besoins métier, pas celle qui fige vos processus dans un pipeline parfait mais rigide. Construisez pour l’évolutivité dès le premier jour.

Accélérez votre transformation digitale avec les experts Power BI et Fabric

Mettre en place un guide automatisation business intelligence de cette ampleur demande du temps, de l’expertise technique et une connaissance fine des enjeux métier. C’est exactement pour cela que BIWORKS accompagne les responsables de transformation digitale depuis la conception de l’architecture jusqu’à la mise en production.

Nos équipes proposent des solutions sur mesure Power BI adaptées à votre contexte, votre volume de données et vos contraintes organisationnelles. Pour ceux qui souhaitent renforcer les compétences en interne, notre formation Microsoft Power BI certifiante et éligible CPF permet à vos équipes de maîtriser Power BI en trois jours, avec une certification PL-300 à la clé. Et pour les projets d’envergure nécessitant une refonte de l’architecture data, notre expertise en architecture data Microsoft Fabric garantit des fondations solides et pérennes pour toute votre organisation.

Questions fréquentes sur l’automatisation de la business intelligence

Quelles sont les étapes clés pour automatiser la Business Intelligence avec Power BI et Fabric ?

Les six étapes d’automatisation BI couvrent l’ingestion via Data Pipelines, la transformation avec Dataflows Gen2, la modélisation sémantique dans Lakehouse, la planification des rafraîchissements, l’utilisation du Direct Lake pour les requêtes en temps réel, et la création automatisée de rapports.

Comment optimiser les temps de rafraîchissement des données dans Fabric ?

En activant le rafraîchissement incrémental, qui ne traite que les données nouvelles ou modifiées, les temps de traitement peuvent être réduits jusqu’à 80% pour les grands jeux de données volumétriques.

Quels sont les avantages des deployment pipelines dans Power BI ?

Ils structurent le déploiement en trois étapes (dev/test/prod) et réduisent la reconfiguration manuelle de 70 à 80%, tout en conservant les règles RLS et en s’intégrant nativement avec Git et les pipelines CI/CD.

Comment intégrer le machine learning dans Power BI avec Fabric ?

Microsoft Fabric permet de former et scorer des modèles ML dans les mêmes flux de données, en intégrant automatiquement les prédictions dans vos rapports Power BI via Dataflows Gen2, sans duplication de logique applicative.